环境准备

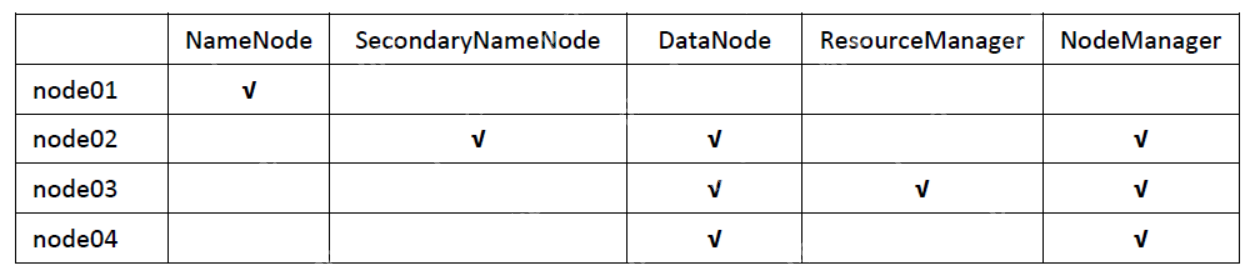

我使用的是centos-6.6版本的4台虚拟机,主机名分别为node01、node02、node03和node04。我将使用hadoop用户来搭建集群(在生产环境中,root用户通常不允许任意使用)。关于虚拟机的安装,可以参考以下两篇文章:在Windows中安装一台Linux虚拟机,以及通过已有的虚拟机克隆四台虚拟机。为集群中的每个虚拟机创建一个hadoop用户,并赋予sudoer权限,参考:Linux用户管理常用命令和Linux给普通用户赋予sudoer权限。每台虚拟机都需要安装JDK,参考在Linux中安装JDK。集群中的所有虚拟机需要实现两两之间以及自身的免秘钥登录,参考配置各台虚拟机之间免秘钥登录。集群中的所有虚拟机的时间需要同步,参考Linux集群系统时间同步。hadoop安装包的下载地址为:https://www.php.cn/link/eecd2755d73701aa057cd2a32bd7b1e2。

- 集群规划

- 安装步骤

(1) 将hadoop安装包上传到服务器并解压

tar zxvf hadoop-2.6.5.tar.gz -C /home/hadoop/apps/

(2) 修改 hadoop-env.sh、mapred-env.sh 和 yarn-env.sh 这三个配置文件,添加JAVA_HOME。hadoop的配置文件位于HADOOP_HOME/etc/hadoop/目录下。

export JAVA_HOME=/usr/local/jdk1.8.0_73

(3) 修改 core-site.xml

<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://node01:9000</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/home/hadoop/hadoopdata</value> </property> </configuration>

<configuration> <property> <name>dfs.namenode.name.dir</name> <value>/home/hadoop/hadoopdata/name</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>/home/hadoop/hadoopdata/data</value> </property> <property> <name>dfs.replication</name> <value>2</value> </property> <property> <name>dfs.secondary.http.address</name> <value>node02:50090</value> </property> </configuration>

(5) 修改 mapred-site.xml。集群中只有mapred-site.xml.template,可以从这个文件进行复制。

cp mapred-site.xml.template mapred-site.xml

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

(6) 修改 yarn-site.xml

<configuration> <property> <name>yarn.resourcemanager.hostname</name> <value>node03</value> </property> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration>

(7) 修改 slaves 配置文件,指定DataNode所在的节点

node02 node03 node04

(8) 将hadoop安装包分发给其他节点

[hadoop@node01 hadoop]# scp -r /home/hadoop/apps/hadoop-2.6.5 node02:/home/hadoop/apps/ [hadoop@node01 hadoop]# scp -r /home/hadoop/apps/hadoop-2.6.5 node03:/home/hadoop/apps/ [hadoop@node01 hadoop]# scp -r /home/hadoop/apps/hadoop-2.6.5 node04:/home/hadoop/apps/

(9) 为每个节点配置HADOOP_HOME环境变量

vim ~/.bash_profile export HADOOP_HOME=/home/hadoop/apps/hadoop-2.6.5 export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

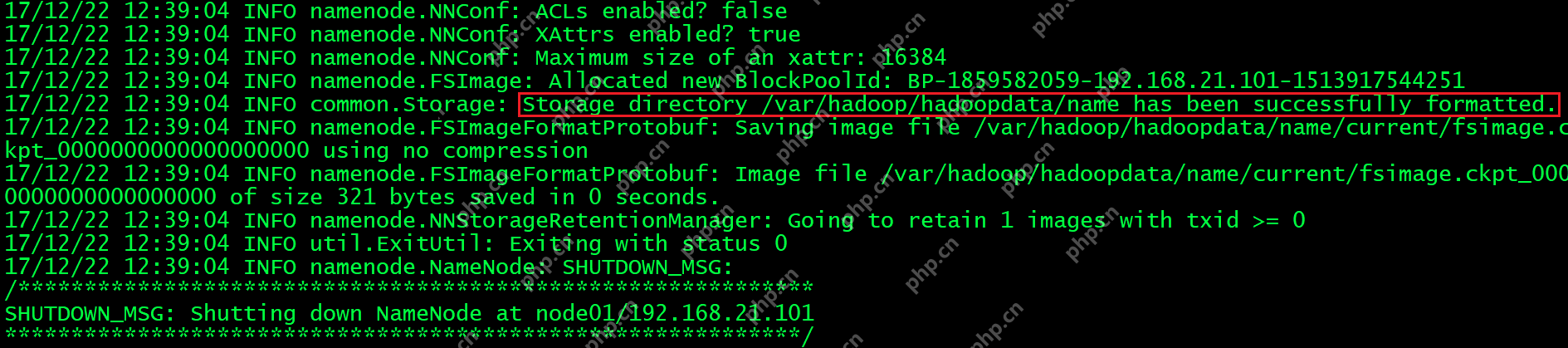

(10) 在namenode主节点(node01)上格式化文件系统

[hadoop@node01 ~]# hdfs namenode -format

看到以下信息说明格式化成功:

(11) 在namenode主节点(node01)上启动hdfs系统

[hadoop@node01 ~]# start-dfs.sh

(12) 在resourcemanager所在节点(node03)上启动yarn

[hadoop@node03 ~]# start-yarn.sh

- 验证集群是否搭建成功

(1) 查看进程是否全部启动

[hadoop@node01 ~]# jps 4000 NameNode 4281 Jps <p>[hadoop@node02 ~]# jps 3442 SecondaryNameNode 3289 DataNode 3375 NodeManager 3647 Jps</p><p>[hadoop@node03 ~]# jps 2945 DataNode 3019 ResourceManager 3118 NodeManager 3919 Jps</p><p>[hadoop@node04 ~]# jps 2899 DataNode 2984 NodeManager 3149 Jps

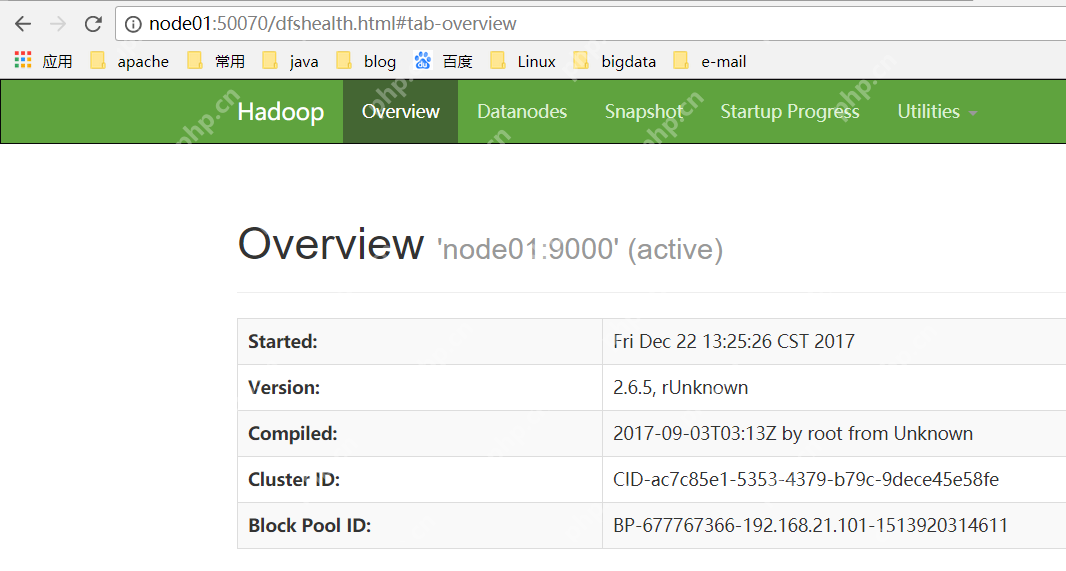

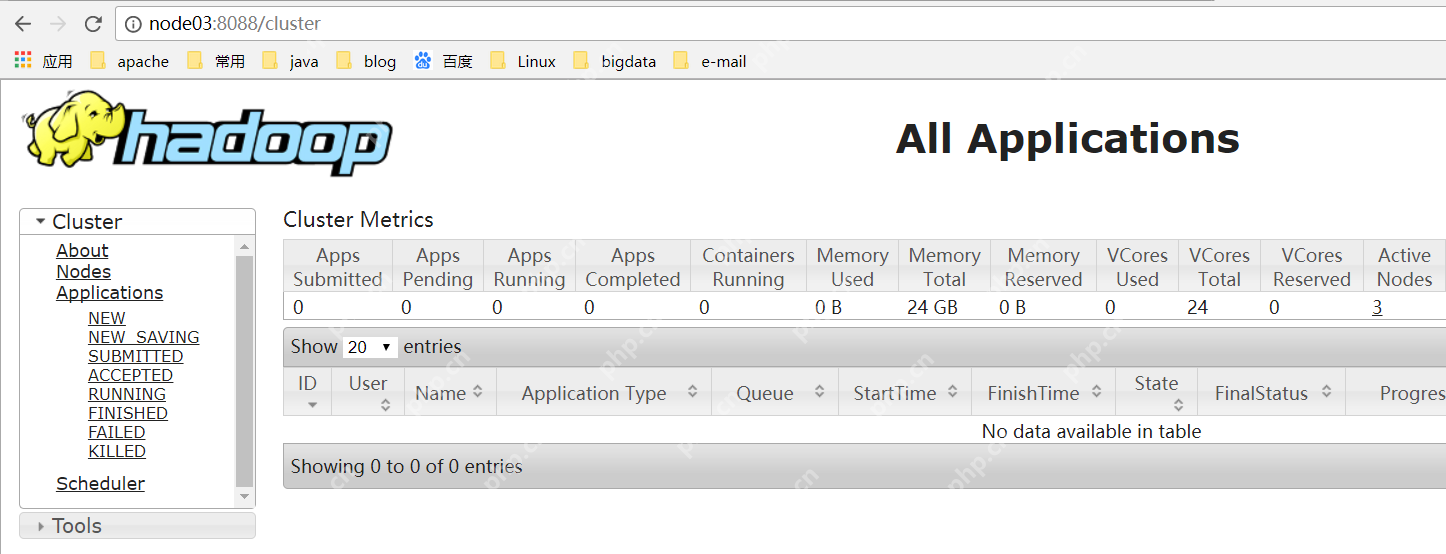

(2) 访问WEB页面

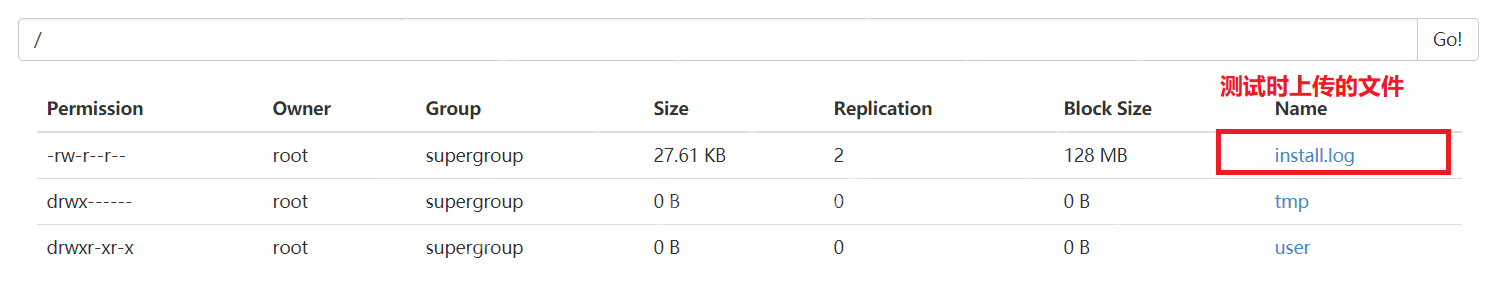

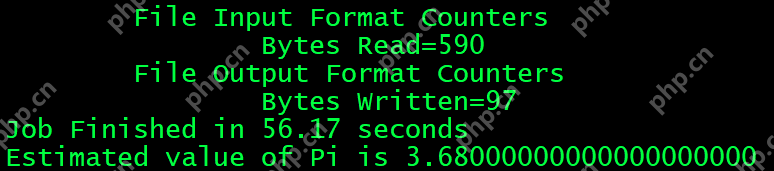

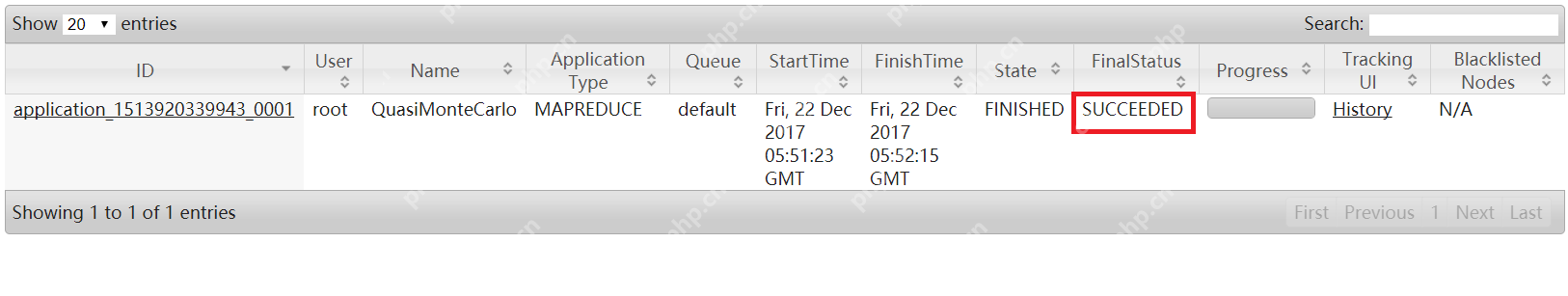

(3) 执行hdfs命令或运行一个mapreduce程序测试

# 上传一个文件 [hadoop@node01 ~]# hdfs dfs -put ./install.log /</p><h1>执行一个mapreduce例子程序</h1><p>[hadoop@node01 mapreduce]# pwd /home/hadoop/apps/hadoop-2.6.5/share/hadoop/mapreduce [root@node02 mapreduce]# hadoop jar hadoop-mapreduce-examples-2.6.5.jar pi 5 5

文件上传成功:

任务成功运行:

到这里,hadoop完全分布式集群就已经搭建成功了!

- 如果hadoop集群需要重装,按以下步骤进行

(1) 删除每个机器中的hadoop日志。日志默认在HADOOP_HOME/logs下,如果不删除,日志文件会越积累越多,占用磁盘。

(2) 删除原来的namenode和datanode产生的数据和文件。删除你配置的hadoop.tmp.dir这个目录,如果你配置了dfs.datanode.data.dir和dfs.datanode.name.dir这两个配置,那么把这两个配置对应的目录也删除。

(3) 再重新修改hadoop配置文件后,按照安装时的步骤进行即可。